Antromorfizam u Vestackoj Inteligenciji

Istraživanja veštačke inteligencije brzo rastu i otvaraju različita etička pitanja vezana za bezbednost, rizike i druge efekte o kojima se u literaturi naširoko raspravlja.

Smatramo da je za adekvatno rešavanje ovih pitanja i uključivanje u produktivnu normativnu diskusiju neophodno ispitati ključne koncepte i kategorije. Jedna takva kategorija je antropomorfizam.

Dobro je poznata činjenica da su funkcionalnosti i inovacije AI često antropomorfizovane (tj. opisane i zamišljene kao okarakterisane ljudskim osobinama).

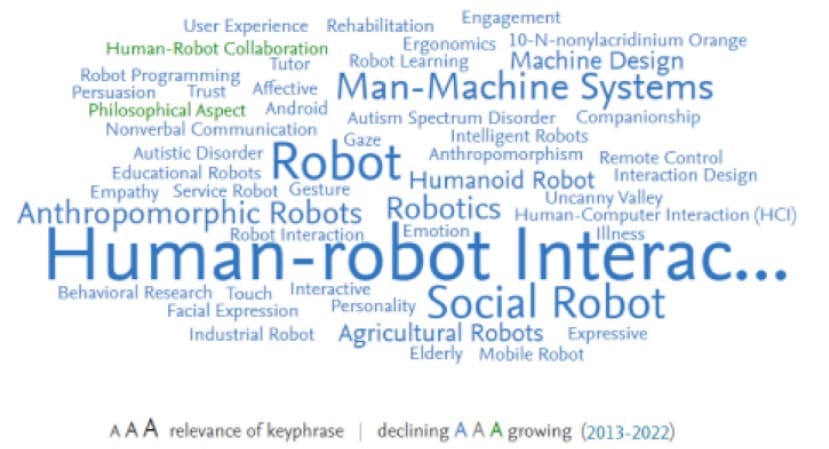

O antropomorfnim stavovima opšte javnosti i nekim njihovim etičkim posledicama (posebno u kontekstu društvenih robota i njihove interakcije sa ljudima) se naširoko raspravlja u literaturi. Međutim, manje pažnje je posvećeno tome kako antropomorfizam prožima samo istraživanje AI (tj. na samom jeziku kompjuterskih naučnika, dizajnera i programera), i kakve bi epistemološke i etičke posledice ovoga mogle biti.

U ovom radu istražujemo ovo pitanje. Prvo smo postavili metodološku/teorijsku fazu, praveći razliku između normativnog i konceptualnog pristupa pitanjima. Zatim, nakon kratke analize antropomorfizma i njegovih manifestacija u javnosti, istražujemo njegovo prisustvo u istraživanju AI sa posebnim fokusom na AI inspirisanu mozgom. Konačno, na osnovu naše analize, identifikujemo neke potencijalne epistemološke i etičke posledice upotrebe antropomorfnog jezika i diskursa unutar istraživačke zajednice AI, čime se pojačava potreba za dopunom praktičnog konceptualnom analizom.

UVOD

Antropomorfizam se generalno definiše kao pripisivanje izrazito ljudskih osećanja, mentalnih stanja i karakteristika ponašanja neživim objektima, životinjama i uopšte prirodnim pojavama i natprirodnim entitetima (Airenti 2015; Eplei et al. 2007).

Važno je imati na umu razliku između doživljavanja društvenih emocija u datoj situaciji, na primer „Sada se povezujem sa svojom mačkom“, i njihovih tumačenja, kao što je verovanje da „moja mačka doživljava vezu isto kao i ja“ . Moguće je doživeti zajednički trenutak sa neljudima, a da stoga ne verujete da oni koji dele taj trenutak moraju imati isto emocionalno iskustvo.

Deljenje može da pretpostavlja minimum sličnosti u smislu uzajamnosti (i životinje, ljudi i mačke, veza), ali ne mora da bude samoprojektivno. Drugim rečima, čak i ako čovek i ne-čovek imaju zajednički trenutak povezivanja, njihova iskustva u tom trenutku mogu biti prilično različita.

Shodno tome, doživljavanje društvene emocionalne blizine sa neljudima ne mora biti antropomorfno. Ovo je delimično važno za zaštitu pripisivanja osećaja, inteligencije, svesti itd. neljudima od optužbi da su samim tim antropomorfni.

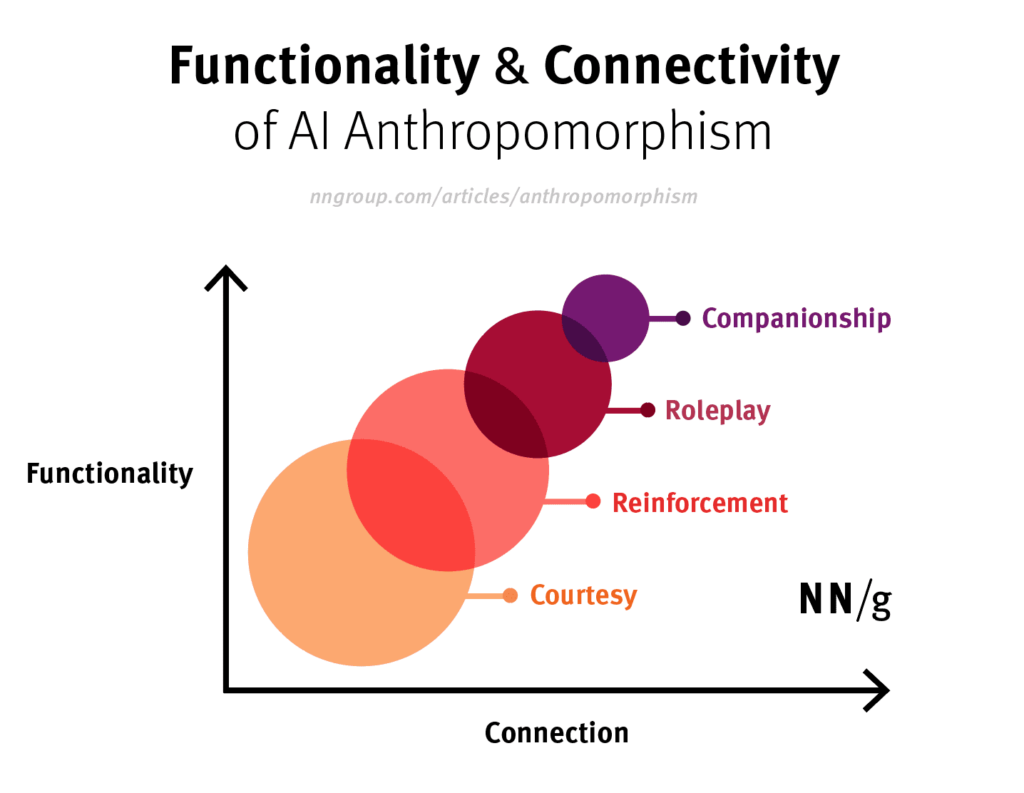

Naš fokus ovde je na tendenciji antropomorfizacije tehnologije, posebno veštačke inteligencije čije unutrašnje delovanje, iako stvoreno od strane ljudi, ostaje neprozirno za laike. Zanimljiva je činjenica da iako generalno postoji tendencija da se tehnološkim artefaktima pripisuju ljudske osobine i motivacije, AI-antropomorfizam dolazi u mnogim verzijama.

Tendencija u popularnoj kulturi da se AI zamišlja kao nalik ljudima (i emocionalno, kognitivno i moralno) značajno je pod uticajem izmišljenih narativa (književna naučna fantastika, filmovi i TV emisije), kao i medijskog pokrivanja AI i robota (Bartneck 2013). Takođe odražava ograničeno razumevanje stanja veštačke inteligencije i njenih mogućnosti.

Iako se ne može reći da je ova antropomorfna tendencija namenjena naučnoj zajednici, ona je u velikoj meri proizvod pogrešne naučne komunikacije koja često rezultira lažnim očekivanjima o tome šta je tehnologija i šta može da uradi, i može izazvati prenaglašene strahove i neopravdana očekivanja.

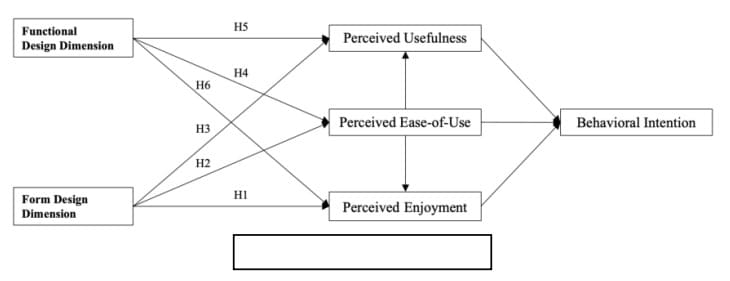

Intelektualizovaniji tip antropomorfizma nalazi se kod korisnika računarskih programa ili virtuelnih asistenata u okviru softverskih programa koji su dizajnirani sa antropomorfnim karakteristikama u nadi da će to olakšati razumevanje relevantne tehnologije, promovisati njeno prihvatanje, povećati njenu efikasnost (Darling 2012, 2017). Zloovski et al., 2015), i očigledne kompetencije korisnika u interakciji sa njima (Epley et al. 2007).

Ono što je zajedničko ovim emocionalnim i intelektualizovanim manifestacijama antropomorfnog mišljenja je da su ih posebno namenili dizajneri veštačke inteligencije: ukoliko se antropomorfizam smatra instrumentalno vrednim, njegovi osnovni mehanizmi su istraženi tako da mogu biti na odgovarajući način pokrenuti interaktivnim AI na različite načine u relevantnim kontekstima.

Antropomorfni jezik se s vremena na vreme čini intrinzičnim za samo polje istraživanja veštačke inteligencije. Zaista, od Tjuringovih opisa njegovih mašina (Proudfoot 1999, 2011) do nedavnih izveštaja o AlphaZero-ovim intelektualnim podvizima (Strogatz 2018) nije neuobičajeno pronaći istraživače koji koriste termine koji se obično koriste za opisivanje ljudskih veština i kapaciteta kada se pominju AI i fokusiranje na navodne sličnosti između ljudi i mašina.

Stoga nije iznenađujuće da se već 1976. godine McDermott slavno žalio na to da istraživači i programeri veštačke inteligencije koriste „mnemotehniku“ (na primer, termini kao što su „razumeti“ ili „naučiti“ odnosili su se na AI za koje je smatrao da dovode u zabludu kako za istraživače tako i za javnost (McDermott 1976), mogli bismo reći da je takav antropomorfizam posledica potrebe da se iskusi kompetencija, odnosno da se razume i kontroliše AI.

Kao polaznu tačku možemo uzeti ključnu knjigu Stuart Russella i Peter Norviga o veštačkoj inteligenciji. Oni sugerišu da su, istorijski gledano, preovladavale dve kategorije definicija veštačke inteligencije: čovekocentrična i racionalistička.

Shvatanja usredsređena na čoveka oslanjaju se na poređenje AI sa ljudima, odnosno na stepen do kojeg može da misli ili deluje kao ljudi.

Racionalistička shvatanja zamišljaju veštačku inteligenciju u smislu suštinske racionalnosti ili ponašanja usmerenog ka cilju, tj. racionalnog razmišljanja ili delovanja (Rasel i Norvig 2010).

Kao što se i očekivalo, pristupi usredsređeni na čoveka su posebno osetljivi na antropomorfne interpretacije: u okviru ovog pristupa, veštačka inteligencija je opisana kao napor da se kompjuteri nateraju da razmišljaju i da im se da um (Haugeland 1985), ili kao automatizacija aktivnosti tipično povezane sa ljudima, kao što su donošenje odluka, rešavanje problema i učenje (Bellman 1978).

AI se stoga često opisuje kao sistemi koji se ponašaju kao ljudi, odnosno mašine koje obavljaju funkcije koje zahtevaju inteligenciju ako ih obavljaju ljudi (Kurzveil 1990), a razvoj AI se shvata kao pokušaj da se kompjuteri nateraju da rade stvari mnogo bolje nego sto ljudi mogu. (Rich and Knight 1991).

Antropomorfna interpretacija unutar istraživačke zajednice AI može imati različite oblike. Veoma široko, to može biti namerno pripisivanje tipičnih ljudskih osobina (npr. kognitivni atributi, namernost, slobodna volja, emocije, itd.)

AI uređajima, može biti suptilnije pripisivanje ekspresivnog ponašanja (npr. osmeh, traženje informacija, itd.) nesvesno antropomorfizovanje AI (Proudfoot 2011) ili može biti razmišljanje da AI sledi način rada sličan čoveku, i da su njegove operacije shodno tome potpuno predvidive i razumljive. U slučaju poslednjeg, čini se da je osnovna (sumnjiva) pretpostavka da postoji mentalna sličnost između ljudi i AI. Ovo je vrsta manifestacije koja se često nalazi u istraživanju veštačke inteligencije inspirisano mozgom.

Čini se da su antropomorfne pretpostavke u osnovi opisa uzajamnog odnosa između neuronauke i veštačke inteligencije, za koje se tvrdi da su kritične za unapređenje obe oblasti. Jedan početni cilj stvaranja korespondencije između funkcionalnosti AI i ljudskog mozga bio je promovisanje boljeg razumevanja mozga, sebe i ponašanja bioloških organizama (Prescott 2015, Prescott i Camilleri 2018).

Ako ovome dodamo činjenicu da su na početku AI, ranih 50-ih, jedini poznati sistemi koji su vršili složene proračune bili biološki nervni sistemi, fokus istraživača AI na mozak kao izvor inspiracije u polju AI u nastajanju je razumljivo (Ullman 2019b).

Istina je da je neuronauka imala koristi od AI – i kao modela za razvoj ideja o funkcionalnom mozgu i kao alata za obradu skupova podataka – a oblast AI je takođe imala koristi od uspešnog oponašanja moždanih aktivnosti.

Međutim, ovo uzajamno pojačanje stoji na pozadini antropomorfnog tumačenja AI (tj. da AI koristi funkcionalnu strukturu koja je dovoljno slična ljudskom mozgu da nam pruži nove uvide u oba domena.

Štaviše, antropomorfizam prisutan u načinu na koji mnogi istraživači AI konceptualizuju i govore o AI ima najmanje dve značajne epistemološke implikacije, jednu za javnost i drugu za same istraživače.

U široj javnosti nenamerno promoviše pogrešna tumačenja i verovanja o tome šta je veštačka inteligencija i koji su njeni kapaciteti. Kao što je ranije pomenuto, ovo predstavlja značajan neuspeh u naučnoj komunikaciji i angažovanju, i ona koja nije etički minorna.. Umesto da proverava i upravlja antropomorfnom tendencijom laika, ona teži da je podržava.

Ali u meri u kojoj sklonost ka antropomorfizaciji oblikuje kako se ljudi ponašaju prema antropomorfizovanom entitetu, takav antropomorfizam ima etičke posledice.

Prvo, percepcija AI kao ljudi podrazumeva njihovo razmatranje kao moralne agente, a njihove postupke kao rezultat autonomnog procesa donošenja odluka (Vaitz et al. 2010), čime imaju normativni uticaj koji ne bi trebalo da imaju.

Drugo, antropomorfizirajuća AI može biti izvor i prenapuhanog straha od AI (da će ljude učiniti beskorisnim, na primer) i nekritičkog optimizma (u vezi sa stepenom do kojeg bi AI zapravo mogao da se ponaša kao ljudi i da obavlja teške zadatke bolje od ljudi).

Konačno, takav antropomorfizam bi mogao stvoriti etičku konfuziju zamagljivanjem moralnih i ontoloških granica.

Anthropomorphism in AI – https://www.tandfonline.com/doi/full/10.1080/21507740.2020.1740350